Scheinbar nicht erklärbare Fehler: Google URL Inspection Tool folgt Weiterleitungen

Wenn das URL Inspection Tool in der Google Search Console scheinbar unerklärbare Fehler anzeigt, kann das daran liegen, dass das Tool bestehenden Weiterleitungen folgt.

Wenn das URL Inspection Tool in der Google Search Console scheinbar unerklärbare Fehler anzeigt, kann das daran liegen, dass das Tool bestehenden Weiterleitungen folgt.

Mit dem URL Inspection Tool in der Google Search Console lässt sich überprüfen, ob bestimmte URLs von Google gecrawlt und indexiert werden können. Manchmal zeigt das Tool jedoch Fehler an, obwohl die URLs einwandfrei funktionieren.

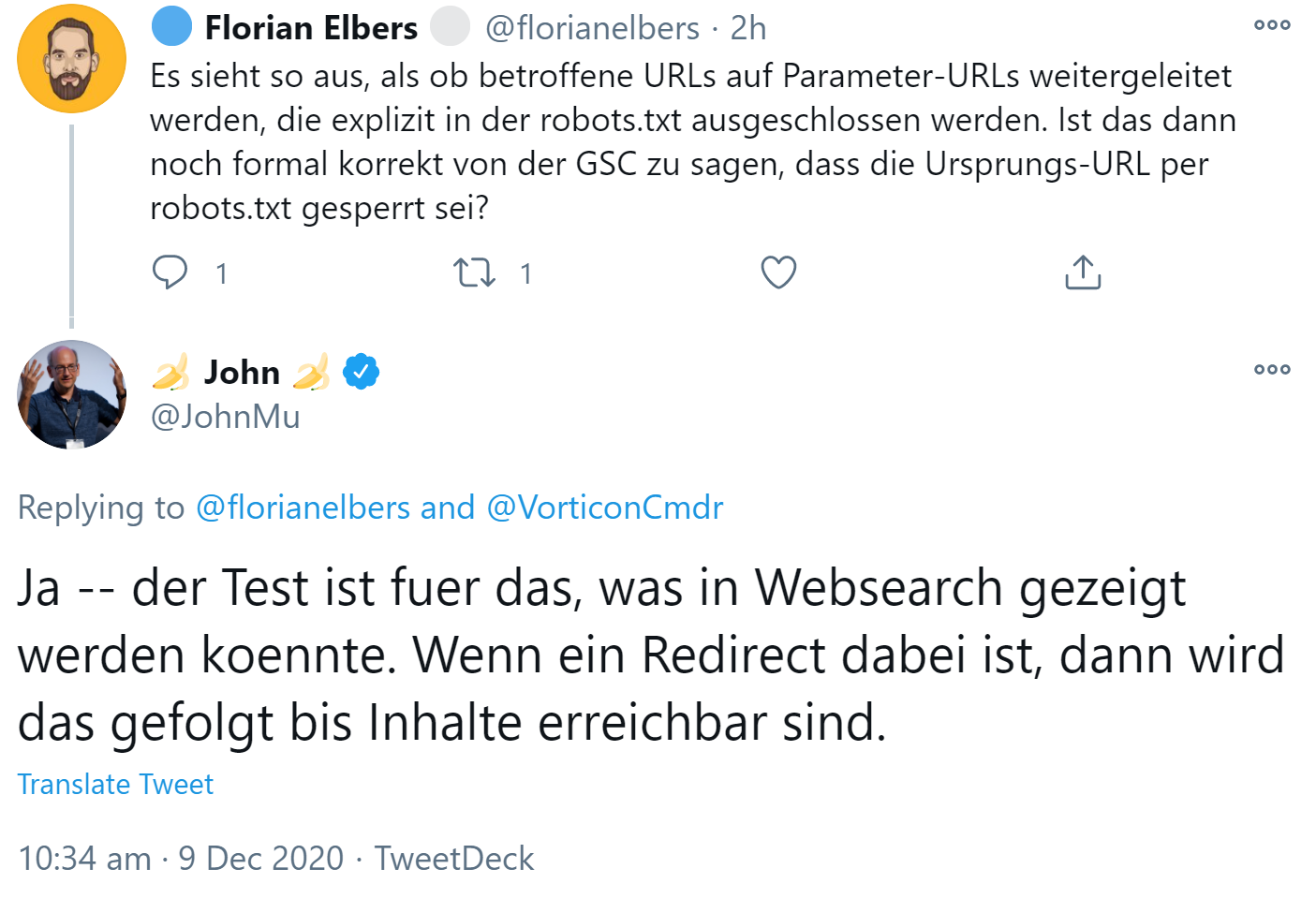

So ist es zum Beispiel möglich, dass eine URL als per robots.txt gesperrt ausgewiesen wird, obwohl sie nicht in der robots.txt angegeben ist und obwohl Googles Tool zum Testen von robots.txt-Dateien aussagt, die URL könne gecrawlt werden.

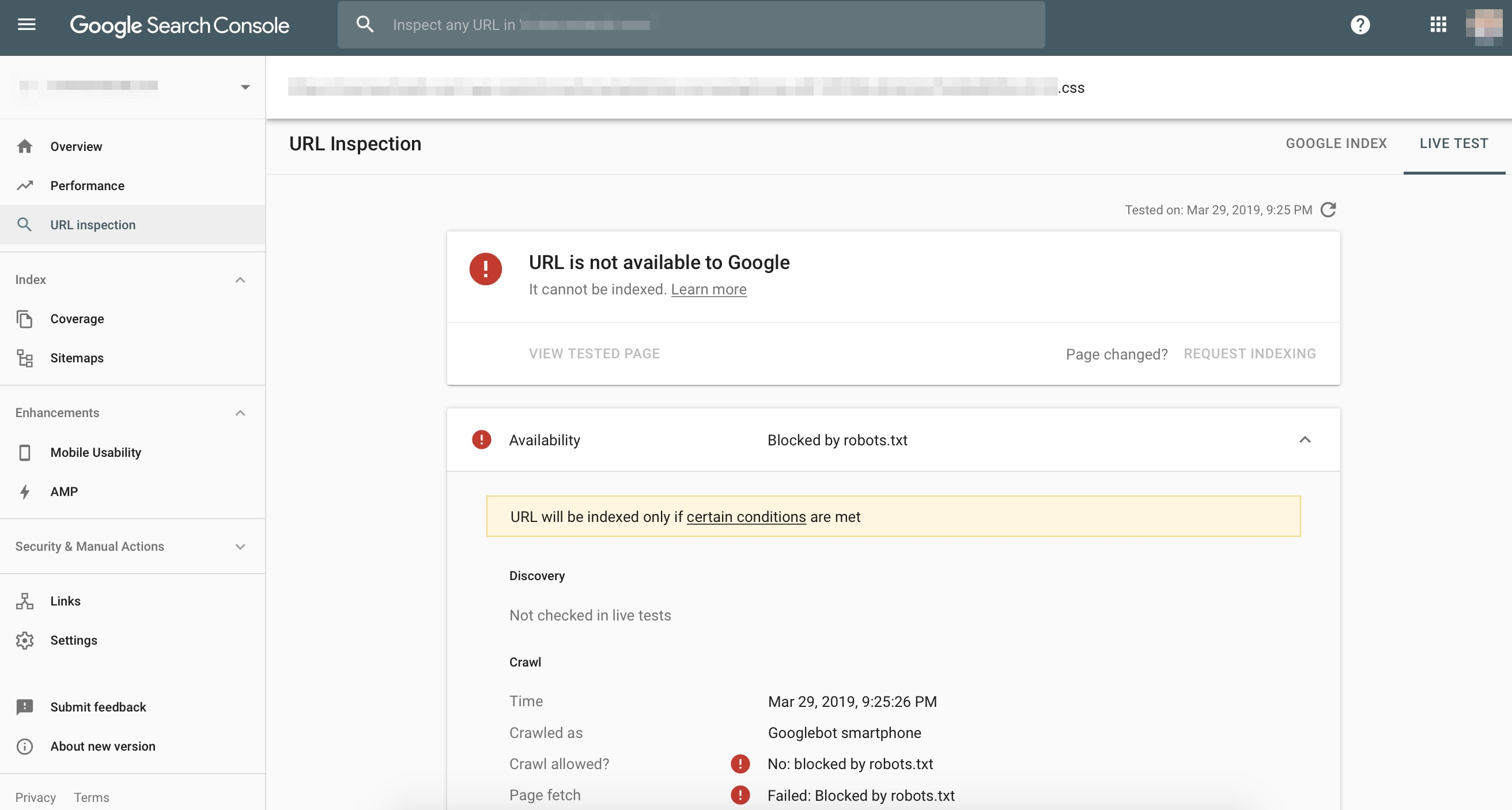

Eine Ursache für diesen Widerspruch kann darin bestehen, dass das URL Inspection Tool bestehenden Weiterleitungen folgt. Das zeigt ein Beispiel, das gerade auf Twitter besprochen wurde. Dabei ging es um eine URL, die auf eine andere URL weitergeleitet wird. Die URL des Weiterleitungsziels ist mit Parametern versehen, die wiederum per robots.txt gesperrt sind. Weil das URL Inspection Tool dieser Weiterleitung folgt, zeigt es die eingegebene URL als nicht indexierbar an:

Eine andere Ursache für die Anzeige von Fehlern für funktionierende URLs ist es, wenn keine HTML-Seiten, sondern URLs von JavaScript- oder CSS-Dateien getestet werden. Für diese Arten von Dateien ist das Tool nicht ausgelegt.

SEO-Newsletter bestellen

Verwandte Beiträge

Es gibt Anzeichen für einen geplanten KI-Bericht in der Google Search Console: AI Contribution Report