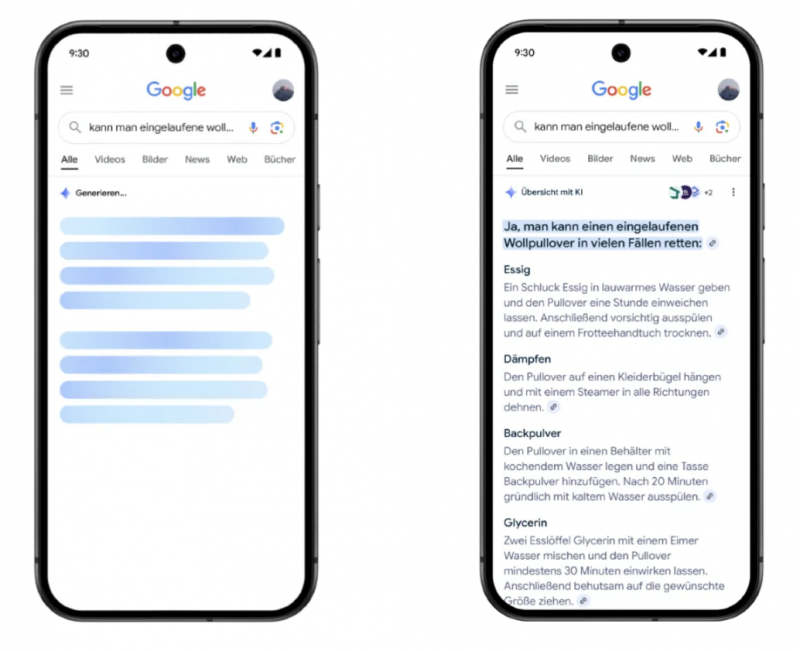

Google AI Overviews: etwa 91 Prozent der Antworten sind richtig

Eine aktuelle Untersuchung der New York Times hat ergeben, dass etwa 91 Prozent der Antworten in den Google AI Overviews korrekt sind. Was auf den ersten Blick gut klingt, erweist sich bei näherem Hinsehen als großes Problem.

Google AI Overviews beziehen sie ihre Informationen aus einer Vielzahl unterschiedlicher Quellen, die von vertrauenswürdigen Websites bis hin zu einfachen Facebook-Beiträgen reichen.

Um die Genauigkeit dieser Antworten zu überprüfen, führte das KI-Start-up Oumi auf Anfrage der New York Times eine groß angelegte Analyse durch. Für den Test wurde der Benchmark-Test “SimpleQA” herangezogen. Die Auswertung der Antworten übernahm dabei Oumis eigenes KI-Verifizierungsmodell mit dem Namen "HallOumi".

SimpleQA ist ein von OpenAI entwickelter Fakten-Benchmark, der speziell darauf ausgelegt ist, die Fähigkeit von KI-Sprachmodellen bei der Beantwortung kurzer, faktenbasierter Fragen zu messen. Das Hauptziel dieses Tests ist es, Halluzinationen messbar zu machen und zu reduzieren, um Modelle vertrauenswürdiger zu gestalten.

Der Test umfasste insgesamt 4.326 Google-Suchanfragen und wurde in zwei Phasen durchgeführt. Die erste Testreihe fand im Oktober statt, als die AI Overviews noch auf dem Modell Gemini 2 basierten. Eine zweite Testreihe folgte im Februar, nachdem Google das System auf Gemini 3 aktualisiert hatte.

SEO-Beratung: Wir sind Ihre Experten

Wir bringen gemeinsam Ihre Website nach vorne. Profitieren Sie von jahrelanger SEO-Erfahrung.

Die Ergebnisse: Mehr Genauigkeit, aber Millionen von Fehlern

Die Analyse von Oumi zeigt, dass sich die Genauigkeit der Antworten von 85 Prozent (Gemini 2) auf 91 Prozent (Gemini 3) verbessert hat. Was nach einem sehr guten Wert klingt, zeigt allerdings bei genauerer Betrachtung ein großes Problem der Skalierung. Google v erarbeitet jährlich mehr als fünf Billionen Suchanfragen. Bei einer Fehlerquote von rund zehn Prozent gibt die KI damit stündlich zweistellige Millionenbeträge an fehlerhaften Antworten aus.

Zusätzlich zeigte der Test, dass mehr als die Hälfte der korrekten Antworten (56 Prozent beim Modell Gemini 3) unbelegt waren, also nicht durch Grounding abgesichert. Bei diesen Antworten belegten die verlinkten Websites die bereitgestellten Informationen nicht vollständig. Für Nutzer ist es so kaum möglich, den Wahrheitsgehalt der Aussagen selbst zu überprüfen. Im Oktober lag dieser Wert bei Gemini 2 noch bei 37 Prozent.

Ursachen für inkorrekte und widersprüchliche Antworten

Die Fehler der AI Overviews haben vielfältige Ursachen. Die Analyse von 5.380 zitierten Quellen zeigt, dass Plattformen wie Facebook und Reddit besonders häufig zitierte Quellen der AI Overviews sind.

Selbst wenn Google eine richtige und vertrauenswürdige Quelle identifiziert, kommt es regelmäßig zu Patzern. Hier einige Beispiele:

- Fehlinterpretationen: Bei einer Frage nach dem Fluss, der an Goldsboro in den USA angrenzt, verwies die KI korrekt auf eine Tourismus-Website der Stadt, zog daraus aber den falschen Schluss über den geografischen Verlauf des Neuse River.

- Ignorieren korrekter Quellen: Bei der Frage, wann Yo-Yo Ma in die "Classical Music Hall of Fame" aufgenommen wurde, verlinkte Google zwar auf die korrekte Website der Organisation, auf der er gelistet war, behauptete im Text jedoch fälschlicherweise, es gäbe keine Aufzeichnungen über seine Aufnahme.

- Falscher Kontext bei korrekter Antwort: Selbst wenn die Hauptfrage richtig beantwortet wird, erfindet die KI teilweise den Kontext. So nannte Google bei der Frage nach dem verstorbenen Baseballspieler Dick Drago zwar das richtige Alter, gab aber wiederholt ein falsches Todesdatum an.

Die Ergebnisse sind außerdem leicht manipulierbar. Ein Journalist konnte die KI erfolgreich austricksen, indem er einen gefälschten Blogpost über eine "South Dakota International Hot Dog Eating Championship" verfasste. Nur einen Tag später wurde er von den AI Overviews ernsthaft als bester Hot-Dog-essender Tech-Journalist aufgeführt.

Google kritisiert die Ergebnisse

Google ist sich der Fehleranfälligkeit bewusst und versieht jedes AI Overview mit dem kleingedruckten Hinweis: "KI-Antworten können Fehler enthalten.”

Gegenüber der Studie von Oumi äußerte Google jedoch scharfe Kritik. Ein Google-Sprecher bezeichnete die Analyse als lückenhaft und erklärte, dass der verwendete SimpleQA-Benchmark selbst falsche Informationen enthalte und nicht das tatsächliche Suchverhalten der Menschen widerspiegele.

Auch wenn Googles eigene interne Analysen zeigten, dass das Basismodell Gemini 3 in 28 Prozent der Fälle falsche Informationen lieferte, betonte das Unternehmen, dass die AI Overviews insgesamt präziser seien als das Modell im Alleingang, weil sie Informationen direkt aus der Google-Suchmaschine beziehen.

Zu empfehlen ist es immer, sich nie auf nur eine Quelle zu beziehen und die Antworten der AI Overviews (wie übrigens alle KI-Antworten) kritisch zu prüfen und zu hinterfragen.

SEO-Newsletter bestellen

Verwandte Beiträge

Google verschafft Websites mehr Sichtbarkeit in der KI-Suche